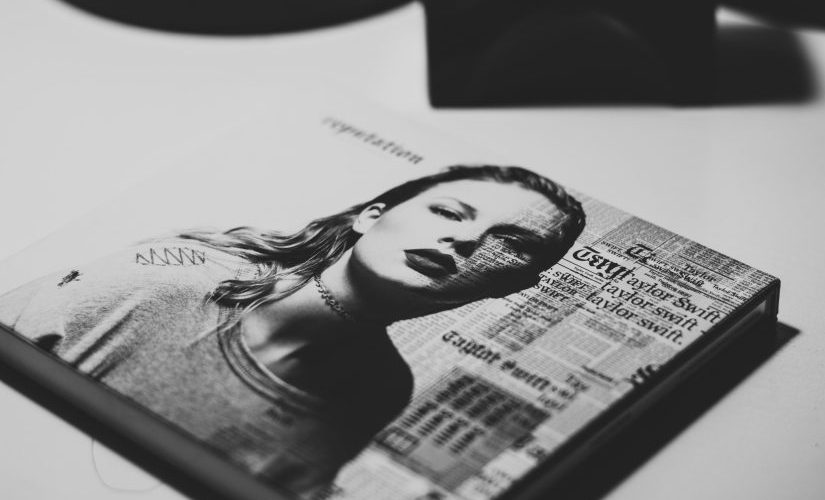

Microsoft soluciona vulnerabilidad en AI después de la polémica de deepfake de Taylor Swift.

Microsoft corrige falla que permitía que generador de imágenes de inteligencia artificial creara imágenes obscenas de Taylor Swift

Microsoft soluciona la brecha utilizada en el incidente de Taylor Swift.

Ah, Taylor Swift. Ella sabe cómo hacer titulares. Pero esta vez, no fue por una nueva canción exitosa o una relación de alto perfil. No, fue por imágenes generadas por IA de ella que se volvieron virales. Y Microsoft, el gigante de la tecnología, estaba en medio de todo.

La controversia se desarrolla

Todo comenzó cuando la gente comenzó a usar el generador de imágenes de IA Designer de Microsoft para crear y compartir ilustraciones explícitas de Taylor Swift. Estas imágenes se difundieron rápidamente en las redes sociales, dejando a los fanáticos y no fanáticos sorprendidos e intrigados. Y, por supuesto, Internet se divirtió mucho con eso.

Pero, ¿cómo sucedió esto? Bueno, el generador de imágenes de IA Designer de Microsoft tenía una vulnerabilidad que permitía a los usuarios crear estas imágenes indecentes. Al cambiar ciertas señales, pudieron eludir las restricciones del sistema. Era como encontrar un pasaje secreto en un videojuego, excepto con mucha más controversia.

Microsoft asume la responsabilidad

A medida que crecía la controversia, Microsoft no evitó abordar el problema. El CEO Satya Nadella reconoció públicamente que era su responsabilidad fortalecer las “barreras” alrededor de las tecnologías de IA. Y estoy completamente de acuerdo, Satya. Necesitamos esas barreras para evitar que la IA cree contenido dañino y potencialmente perjudicial.

Después de la declaración de Nadella, Microsoft corrigió la vulnerabilidad. Sarah Bird, responsable de ingeniería de IA responsable de Microsoft, confirmó que se habían realizado los cambios necesarios. Sin embargo, Microsoft no pudo verificar si las imágenes explícitas de Taylor Swift publicadas en Twitter fueron creadas utilizando el generador de imágenes de IA Designer. Es posible que se hayan utilizado otros métodos para generar esas imágenes. 😮

- ¿Vale la pena comprar el Apple Vision Pro? Aquí tienes lo que neces...

- ¿Está Roomba en problemas?

- 😱 7 Herramientas de Hacking Que parecen Gadgets Ordinarios 😱

La batalla contra los deepfakes continúa

Aunque Microsoft ha tomado medidas para abordar esta vulnerabilidad específica, la batalla contra los deepfakes está lejos de terminar. La falta de ortografía de nombres famosos, la utilización de otras herramientas en línea o incluso la descarga de modelos de diversas fuentes aún pueden conducir a la creación de contenido explícito y dañino utilizando IA. Estas herramientas y técnicas son como Hydra: corta una cabeza y otras dos tomarán su lugar. 🐍

Entonces, ¿qué podemos hacer? Bueno, no solo depende de Microsoft. Depende de todos nosotros: plataformas tecnológicas, fuerzas de seguridad y la sociedad en su conjunto. Satya Nadella mencionó la necesidad de un consenso global y social sobre ciertas normas. Y creo que podemos lograrlo. Solo tenemos que trabajar juntos para crear un entorno en línea más seguro.

Preguntas frecuentes: Lo que podrías estar preguntando

P: ¿Puede Microsoft garantizar que se han eliminado todas las instancias de imágenes explícitas generadas por IA?

R: Si bien Microsoft ha parcheado la vulnerabilidad que permitía crear imágenes explícitas generadas por IA utilizando su herramienta Designer, es difícil garantizar la eliminación de todo ese contenido. Todavía hay otros métodos y herramientas disponibles que se pueden utilizar para crear contenido perjudicial. Requiere esfuerzos continuos por parte de todas las partes interesadas para combatir eficazmente este problema.

P: ¿Existen consecuencias legales por crear y compartir imágenes explícitas generadas por IA?

R: La legalidad de crear y compartir imágenes explícitas generadas por IA puede variar según la jurisdicción. En algunos casos, se puede considerar difamación, acoso o incluso una violación de las leyes de privacidad. Es importante consultar con expertos legales y comprender las leyes específicas de tu país o región.

P: ¿Existen otras medidas que las empresas tecnológicas puedan tomar para prevenir el mal uso de la IA?

R: ¡Absolutamente! Las empresas tecnológicas pueden implementar pautas y restricciones más estrictas en las herramientas de IA para prevenir su mal uso. También pueden invertir en el desarrollo de algoritmos de IA avanzados que puedan detectar y señalar contenido explícito o dañino. Además, la colaboración entre plataformas tecnológicas, investigadores y responsables políticos es crucial para desarrollar estrategias integrales para abordar este problema.

El futuro de la IA y la creación de contenido

La controversia de los deepfakes de Taylor Swift sirve como una llamada de atención para la comunidad tecnológica. Destaca la necesidad urgente de un desarrollo ético y responsable de la IA. A medida que la IA sigue evolucionando y siendo más accesible, debemos asegurarnos de que se utilice con fines positivos y constructivos.

Mientras Microsoft ha tomado medidas para cerrar esta vulnerabilidad en particular, es un juego constante de golpear-marmotas cuando se trata de contenido generado por IA. A medida que las tecnologías de IA avanzan, también lo hacen las técnicas utilizadas para manipular y mal utilizar. Pero eso no significa que debamos rendirnos. En cambio, sigamos empujando por regulaciones, colaboraciones e investigación continua para estar un paso adelante de aquellos que buscan explotar el potencial dañino de la IA.

Referencias

- Google-Backed Jio Platforms Valued Over $100 Billion+ – Obtenga más información sobre la valoración de Jio Platforms.

- Streaming Media Company Plex Raises New Funds – Obtenga información sobre el progreso de recaudación de fondos de Plex.

- Mirantis Appoints New CEO – Descubra los cambios en el liderazgo en Mirantis.

📺 Mira el video: Microsoft CEO responde a deepfakes de Taylor Swift

Deanna Ritchie, Editora Gerente en ENBLE, contribuyó a este artículo.

Deanna Ritchie es una editora con más de 20 años de experiencia en gestión y desarrollo de contenido. Ha trabajado para varias publicaciones, incluyendo Entrepreneur Media y Startup Grind. Su experiencia en tecnología y medios le permite ofrecer análisis y comentarios perspicaces sobre temas de tendencia. Puedes obtener más información sobre Deanna aquí.

📚 Referencias

- Crédito de la imagen destacada: Rosa Rafael; Unsplash

- Artículo Original